2023-10-18

欢迎来到学次元

登录以继续使用浏览

请使用微信扫一扫

二维码加载中...

or

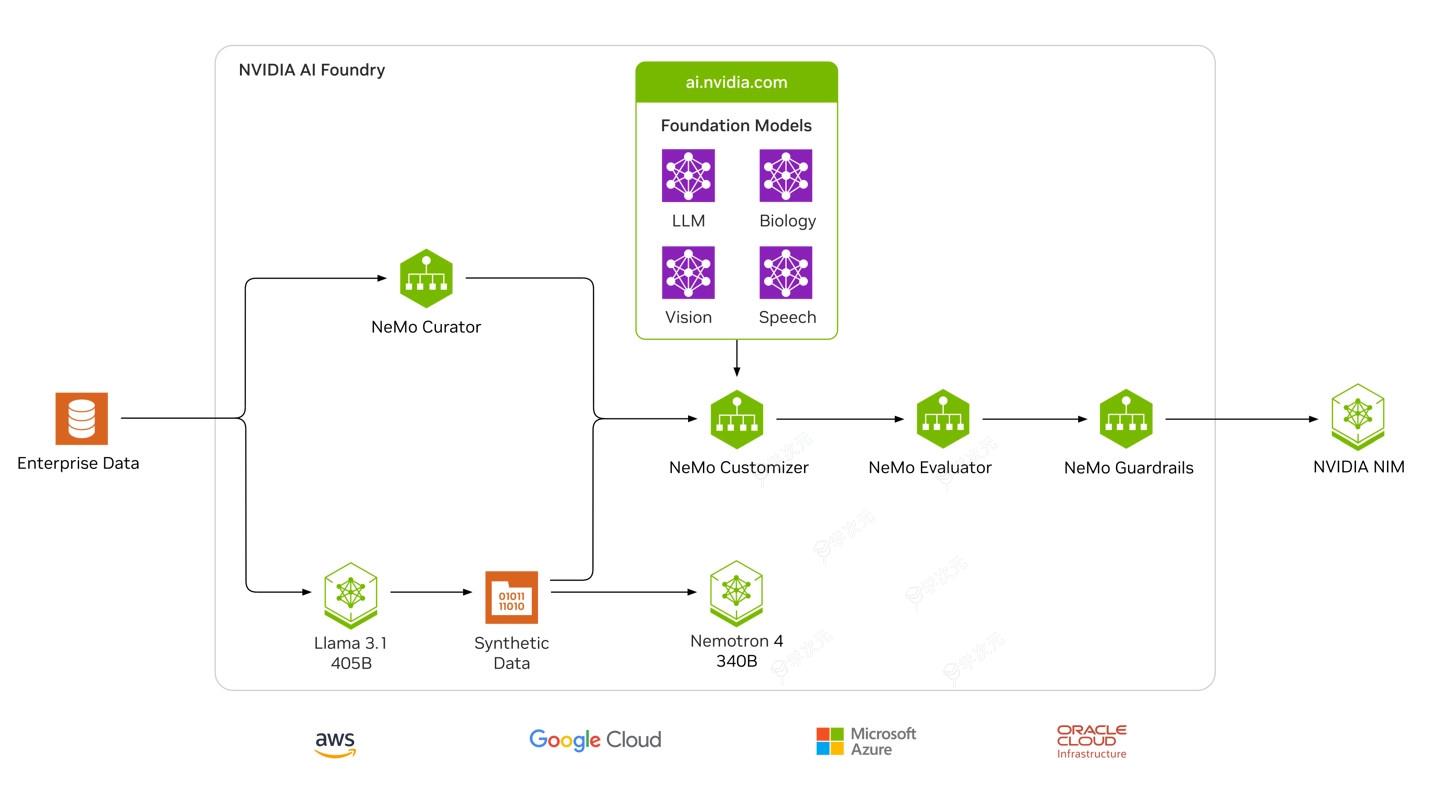

IT之家今日(7月24日),英伟达公司昨日(7 月 23 日)发布新闻稿,正式推出“NVIDIA AI Foundry”代工服务和“NVIDIA NIM”推理微服务。

“NVIDIA AI Foundry”代工服务

英伟达表示客户可以使用 Meta 的 Llama 3.1 AI 模型,以及英伟达的软件、计算和专业知识,为特定领域定制构建“超级模型”。

客户可以利用专有数据、由 Llama 3.1 405B 和英伟达 Nemotron Reward 模型生成的合成数据来训练这些“超级模型”。

NVIDIA AI Foundry 由 NVIDIA DGX™ Cloud AI 平台提供支持,该平台与世界领先的公共云共同设计,为企业提供大量计算资源,并可根据 AI 需求的变化轻松扩展。

NVIDIA AI Foundry 包括 Nemotron 和 Edify 等英伟达创建的 AI 模型、流行的开放式基础模型、用于定制模型的 NVIDIA NeMo™ 软件,以及 NVIDIA DGX™ Cloud 上的专用容量(由 NVIDIA AI 专家构建并提供支持)。

输出结果由 NVIDIA NIM(一个推理微服务,其中包括定制模型、优化引擎和标准 API)负责,可以部署到任何地方。

NVIDIA NIM 推理微服务

NVIDIA NIM 是一套加速推理微服务,允许企业在云计算、数据中心、工作站和 PC 等任何地方的 NVIDIA GPU 上运行AI模型。

通过使用行业标准的 API,开发人员只需几行代码就能利用 NIM 部署人工智能模型。NIM 容器无缝集成 Kubernetes(K8s)生态系统,可以高效地协调和管理容器化人工智能应用。

展开内容